第一作者简介:黄威,男,辽宁锦州人,博士,研究员,研究方向为应用统计、物证技术。E-mail: huangwei24@aliyun.com

本文研究采用新型卷积神经网络HF-Net的深度学习技术将光谱数据在三维重建稠密点云上进行重定位的可行性。首先基于HF-Net多任务学习的光谱重定位方法,是一种异构的定位方法,使用MobileNet和NetVLAD层提取光谱图像的全局描述子,在三维重建彩色点云的数据集进行全局检索,得到此光谱照片对应的三维点云的大致位置。使用光谱图像的局部描述子和关键点得分,进行局部特征匹配,找到光谱图像中的光谱信息,对应三维模型点云中的匹配点,从而完成光谱信息和三维模型的映射。结果表明,通过HF-Net实现光谱特征点匹配后,可以将光谱信息完整地映射到三维重建模型上。本文提出的方法,可以实现立体物证的三维空间信息和光谱特征的精细定位,是人工智能在物证全维度影像数据融合技术中的新应用。

3D-reconstructed relocation of spectral feature is a key technology in multi-spectral imaging fusion and 3D reconstruction. Here, the feasibility was to explore about relocating spectral data onto 3D-reconstructed dense point cloud through a new neural network HF-Net, one deep-learning-based AI technology and also a hierarchical localization approach based on a monolithic CNN that is able to simultaneously predict local features and global descriptors for spectral localization. Such an HF-Net was adopted to carry out the spectral relocation of heterogeneous localization. Specifically, the MobileNet and NetVLAD layers were taken to extract the global descriptors among the dataset of three-dimensional color point cloud from the spectral image so as to find the approximate position of spectral image in the three-dimensional point cloud. With the conjectural locations obtained through the prior global retrieval within those candidate places, the SuperPoint was utilized to get the local descriptors and key point scores of the spectral image so that the matching spectral points were found in the three-dimensional point cloud, therewith having mapped out the spectral information and three-dimensional reconstruction pattern. By leveraging the learned descriptors, this assay achieved remarkable localization robustness across large variations of appearance, demonstrating more robust and efficient than SSD algorithm. Due to limits with GPU (graphics processing unit) memory, the extracted spectral features were down-sampled from image to the largest resolution of 6016 × 4512 pixels. With HF-Net being trained through multi-task distillation in TensorFlow 1.12, a spectral image had been able to relocate into 3D reconstruction pattern in 12s under having run on the device of NVidia TESLA V100 with 32G memory and CPU of Intel (R) Xeon (R) Silver 4114 with 12G memory. The approach proposed here can realize the fine positioning of 3D spatial information and spectral features of 3D physical evidence. At present, there seems no such an exploration in forensic science home and abroad, revealing that the exploration tried here is a new application of artificial intelligence to the full-dimensional imaging data fusion technology of physical evidence. Such an HF-Net-based relocation is accurate, scalable, efficient, and a monolithic deep neural network choice for descriptor extraction, capable of achieving higher exactness on large-scale multi-spectral imaging fusion and 3D reconstruction.

进入信息化时代以来, 基于智能三维重建技术的物证数字化检验已经成为推动大数据、人工智能等科技创新成果与司法工作深度融合的重点研究方向。基于计算机视觉的三维重建技术, 在各类案件宏观尺度下的研究与应用取得丰富成果的同时[1, 2, 3], 也面临着三维重建结果功能单一、应用场景趋于同质、数据信息利用不充分等瓶颈问题。另一方面, 以光谱成像为代表的新型数字影像技术虽然在检验内容、显现能力、提取效率等方面弥补了传统影像技术的不足[4, 5], 但是由于其采集的仅是二维平面数据, 对物证细节信息可能存在遗漏, 也无法获得物证立体空间位置关系, 在检验结果的表现形式和与人工智能创新融合等方面有待加强。因此, 三维光谱成像技术将是物证数字化检验重要的研究方向。目前国内外尚未见成熟的三维光谱成像技术, 主要原因有:

1)光谱信息无法直接用于三维重建。

为了能够准确获取客体表面指纹、血迹等物证信息, 光谱相机一般采用大光圈、近景深的拍摄方法, 对于立体图像或焦平面远端的场景成像质量较差。如何将光谱信息准确映射到高清三维模型上, 解决方法尚不成熟。

2)传统的三维重建特征描述符不适用于光谱信息映射。

例如尺度不变特征变换描述符(scale-invariant feature transform, SIFT)[6, 7]和基于二进制的特征提取描述符(binary robust invariant scalable keypoints, BRISK)[8, 9, 10, 11]等, 虽然能对光谱图像进行特征提取和描述计算, 但是提取的精度和普通彩色图像上提取的精度具有较大差距, 给光谱信息在三维模型上的重定位和注册带来了困难。

3)光谱信息数据量巨大, 匹配维度过大。

采集一个位姿就会有数十幅甚至上百幅不同波长的光谱影像集, 随着尺度的增加, 需要匹配的数据量将更加巨大, 感知混叠的出现使得传统方法的匹配变得模糊, 削弱了定位的稳健性。

为了同时获取目标的三维空间信息和光谱信息, 笔者利用现有技术从数据采集源头入手, 探索过一种将立体成像与高光谱成像数据一体化获取的方案, 即利用激光三维扫描系统与高光谱成像仪获取数据进行融合的尝试。但是由于成像机制和数据获取连续性的差异, 以及拍摄稳定性不足的缺陷, 增加了不同平台获取数据的配准难度, 使得多维数据融合处理精度与信息提取效率受到了较大的制约。而且由于需要使用特定的激光扫描设备进行采集, 灵活性和便携性较差, 不适合现场物证数据采集。

本文采用普通相机拍摄的彩色图像完成三维重建, 采用HF-Net架构卷积神经网络完成光谱图像的视觉定位技术, 将光谱信息准确映射到高清三维模型上, 最终实现三维光谱模型的构建。不仅大大提升了物证采集的灵活性, 而且三维重建模型的图像分辨率会显著高于激光三维扫描的重建分辨率。

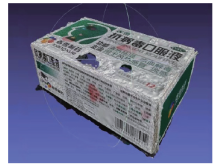

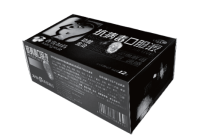

普通纸质药盒1个, 三边尺寸为15 cm× 9 cm× 5 cm, 随机选择3个表面, 分别捺印红色印泥手印(见图1)。样本制作完毕后, 在自然条件下放置3 d。

HIMI-VIS光谱成像仪(广州星博科仪有限公司); 卤素灯(北京欧亿上佳照明公司); 小米11手机(小米科技有限责任公司); 数据处理运行环境:GPU TESLA V100, 显卡内存32 G, CPU Intel (R) Xeon (R) Silver 4114, 系统内存12 G。

光谱影像集采集方法:使用卤素灯均匀配光, 波长范围400~720 nm, 波长间隔10 nm, 自动曝光时间模式, 分别采集纸质药盒6个平面各33张光谱图像数据。

三维重建彩色图像采集方法:使用手机拍照功能, 从48个角度围绕纸质药盒分别拍摄(图2), 得到48张2 800万像素彩色图像。

三维光谱成像过程如图3所示, 将物证材料分别通过普通彩色相机和光谱相机进行拍摄, 获取彩色图像和光谱图像。

1)通过光谱影像分析实现光谱图像分类, 通过计算两两光谱图像的夹角余弦相似系数, 将相似的图像归为一类, 通过将相似图像分类, 可以降低光谱图像重定位的检索空间, 提升匹配效率。

2)通过运动恢复结构算法(structure-from-motion, SFM)[12]完成相机位姿估计, 并通过蝙蝠算法(bat algorithm)[13]完成相机的迭代优化, 利用相机位姿反推获得彩色图像的三维点云, 并通过泊松重建[14]和纹理贴图, 构建物证的彩色三维重建模型。

3)将分类后的光谱影像通过基于HF-Net架 构[15, 16]的深度神经网络实现光谱特征在三维彩色模型上的重定位。

4)通过纹理重贴图, 生成光谱三维模型。

1.4.1 光谱影像分析

使用MIsystem软件光谱特征整体匹配方法对采集到的光谱影像集进行指纹显现处理。光谱特征整体匹配有很多方法, 如基于几何特征、统计特征、变换域特征的方法。这些方法都是采用某一度量距离函数进行计算, 如利用范数(常用的为欧氏范数)、相关系数、夹角余弦相似系数等方法、Hausdorff距离等。本文使用的是相关系数和夹角余弦两种方法。

两个随机变量X, Y的相关系数ρ XY定义如下:

$\rho_{X Y}=\frac{\operatorname{Cov}(X, Y)}{\sqrt{D(X)} \sqrt{D(Y)}} $(1)

其中Cov(X, Y)为X和Y的协方差; D(X), D(Y)分别为X、Y的方差。相关系数越大, 表示X、Y存在线性关系的概率越大, 当相关系数为1时, 表示存在确定的线性关系, 即Y=kX。相关系数定义简单, 意义明确, 在实际的光谱曲线匹配中经常使用。两个向量X、Y的夹角余弦系数CXY定义如下:

$C(X, Y)=\frac{\sum_{k=1}^{n} x_{k} y_{k}}{\sqrt{\left(\sum_{k=1}^{n} x_{k}^{2}\right)\left(\sum_{k=1}^{n} y_{k}^{2}\right)}} $(2)

夹角余弦在图像识别中的应用比较广泛, 对于形状相同而尺度不同的曲线也可以进行匹配。在通用的光谱影像匹配中, 夹角余弦作为一种有效度量方法, 常常成为研究人员的首选方法。

1.4.2 彩色图像三维重建

1)使用彩色图像构建稠密点云。通过彩色二维图像的SFM算法, 确定每张彩色二维图像的相机位姿, 并通过蝙蝠算法对相机的位姿图进行迭代优化, 得到可靠的相机位姿。在相机位姿的基础上, 融合每一个相机位姿对应的深度图, 得到物体的稠密点云图。

2)构建模型。利用稠密点云完成立体模型重建, 构建三维网格(3D mesh)或者面元(Surfel)图。常见的有泊松重建、Surfel重建、八叉树地图, VRIP算法。本文采用是的泊松重建方法[16]。

3)纹理贴图。对没有纹理的三维模型, 需要通过立体贴图得到最终的彩色模型, 光线投射是立体贴图的方法之一, 它的理论基础是观察投射光线到物体上的每个点, 查找阻挡光线的最近物体, 也就是将图像当作一个屏风, 每个点就是屏风上的一个正方形。成像平面每个像素沿着视线方向发出一条射线穿过体数据, 沿着这条射线等距离重采样, 求出各重采样的颜色值和阻光度, 然后按照由前向后或由后向前的方式合成射线上各重采样点的颜色和阻光度, 即得到该像素颜色。本次实验中, 三维重建运行时间15 min。

1.4.3 光谱特征重定位

光谱图像的视觉定位, 关键要解决光谱相机位姿估计与三维模型的空间重定位问题, 最主要的挑战是建立输入光谱图像数据与基准三维点云数据之间的相关性。传统的视觉定位方法被分为基于结构或基于图像两类, 大都采用判别的方法, 依赖强有力的特征描述算子来建立各种观测条件下同一关键点之间的联系。然而, 在实际情况下, 观测条件的不确定性使得现有特征描述算子很难准确捕捉各个关键点的稳定性, 尤其在缺少特征的地方往往会发生定位失败, 缺乏鲁棒性。基于图像检索的替代定位方法最近在稳健性和效率方面显示出不错的结果, 但在准确性方面没有竞争力。近年来, 基于卷积神经网络的关键点检测在使用较少的计算开销同时, 表现出了无与伦比的鲁棒性。

本文使用一种用于分层特征的新型神经网络HF-Net, 可以实现高效的精细定位。它可以一次性检测关键点并计算局部和全局描述符, 从而最大限度地提高计算共享, 同时保留较大基线网络的性能。HF-Net架构由单个编码器和三个头预测(关键点检测分数、密集局部描述符和全局图像范围描述符)组成。

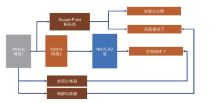

1)训练过程。首先, 通过MobileNet[17]实现三维重建彩色点云(point cloud)的提取特征, 输出的特征图用于后续的全局描述子(global descriptor)、关键点得分(key point scores)、局部描述子(local descriptors)的预测。其次, 通过SuperPoint解码, 使用一种非学习的固定方式得到三维重建彩色点云的关键点得分和局部描述子。然后, 通过MobileNet和NetVLAD层实现对三维重建彩色点云的全局描述子的提取(图4)。

2)重定位过程。将光谱图像放入HF-Net中进行计算, 分别得到全局描述子、局部描述子、关键点得分, 使用光谱图像的全局描述子, 在三维重建彩色点云的数据集进行全局检索, 检索得到此光谱照片对应的三维模型的大致位置。使用光谱图像的局部描述子和关键点得分, 进行局部特征匹配, 找到光谱图像中的光谱信息, 对应三维模型点云中的匹配点, 从而完成光谱信息和三维模型的映射。再通过HF-Net网络实现光谱特征点的匹配, 就可以将光谱信息完整地映射到三维重建的模型上去, 从而实现三维光谱成像物证检验的目标(见图5)。

| 图5 光谱图像的特征点在彩色图像三维模型上的重定位Fig. 5 Relocation of feature points of spectral image onto three-dimensional pattern of color image |

此过程的运行框架:Tensorflow 1.12; 当1张光谱影像处理结果匹配4张彩色照片时, HF-Net运行时间:12 s。

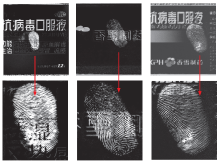

使用MIsystem软件对纸质药盒三个不同表面处理结果和显现的捺印指纹放大结果如图6所示。通过光谱影像分析, 可以将纸盒表面的潜在指纹全部显现出来, 并清晰放大, 对于后续光谱特征重定位提供了较好的影像素材。

通过多角度高清彩色图像完成的物证三维重建效果见图7。由于本文采用基于普通相机拍摄的彩色照片完成物证的三维重建, 无需专业的激光扫描设备, 应用场景更灵活, 更适合现场物证采集。而且三维重建模型的图像分辨率显著高于激光三维扫描的重建分辨率。本文重建的三维模型的彩色分辨率为6 016 × 4 512, 约2 700万像素, 而目前市场上分辨率最高的激光扫描重建设备, 最大分辨率900万像素。

三维重建技术能够记录杀人、纵火、爆炸、交通肇事等各类案件现场立体空间信息, 与虚拟现实技术结合可以实现异地同步现场勘查、现场环境以及物证几何测量、数字化现场复勘与展示等功能。目前的研究工作主要集中在宏观场景三维重建速度和精度等方面, 对物证信息的深度挖掘和检测识别等方面研究还不够深入。光谱成像技术在痕迹物证的无损发现与识别等方面具有明显的优势。针对作案工具、侵害对象、现场遗留物品等多尺度物证检材, 将三维重建与光谱成像相结合, 建立物理空间与光谱信息融合的立体勘查取证技术, 能够发挥两项技术的优势, 检验结果对于分析和理解各类痕迹物证的空间分布状态、相互关系以及所反映的行为人特点等具有重要意义, 为基于计算机视觉的现场快速记录与智能重建技术提供了新的思路。

本文对规则的立方体样本进行了三维建模和光谱信息重定位实验研究。结果表明, 本文提出的方法能够实现三维光谱成像融合检验的目的, 下一步将针对不同材质的球体、圆柱体以及不同大小的不规则立体样本进行系统实验。另外, 如何发挥三维光谱成像技术在现场和实验室检验工作中的应用能力, 也是继续研究的方向。

本文研究了基于HF-Net架构卷积神经网络深度学习图像目标位姿估计方法, 探索了三维建模与光谱信息相融合的智能重建技术, 为建立物理空间与信息空间相结合的立体勘查取证模式进行了有益的尝试, 实验结果证明三维光谱成像技术在物证综合信息的深度挖掘和精准测量方面具有较大的应用潜力, 拓展了三维重建技术和光谱成像技术在物证检验中的应用范围。

| [1] |

|

| [2] |

|

| [3] |

|

| [4] |

|

| [5] |

|

| [6] |

|

| [7] |

|

| [8] |

|

| [9] |

|

| [10] |

|

| [11] |

|

| [12] |

|

| [13] |

|

| [14] |

|

| [15] |

|

| [16] |

|

| [17] |

|